Foram encontradas 50 questões.

O texto abaixo servirá de base para a questão.

O perigo da inteligência artificial para a humanidade

Rafael Ciscati e Marcos Coronato

Na ficção científica, a inteligência artificial, ou I.A., tem alguns papéis recorrentes. Costuma

brilhar como a antagonista que pretende exterminar a humanidade. Esse é o propósito da Skynet,

a versão militar e maligna da internet, no filme O exterminador do futuro: gênesis, a estrear em

2015. Nos últimos meses, os perigos da I.A. vêm sendo discutidos mais seria mente por gente

brilhante como o astrofísico Stephen Hawking e o empresário Elon Musk, atuante nos setores

de carros elétricos e exploração espacial. Porém, poucos atentaram à ideia central do pensador

que desencadeou a discussão. O filósofo sueco Nick Bostrom não teme que as I.A’s. detestem

pessoas ou que tentem machucá-las e afirma que “essas máquinas serão indiferentes a nós”.

Formas de I.A. indiferentes à humanidade ou com estratégias incompreensíveis por nós

poderiam causar destruição física e caos social ao controlar bancos de dados, mercados

financeiros, infraestrutura, redes de distribuição e sistemas de armamentos. Bostrom,

pesquisador na Universidade de Oxford, no Reino Unido, dirige o Instituto para o Futuro da

Humanidade. Pesquisa riscos existenciais à vida humana, como a colisão de asteroides com a

Terra. O surgimento da I.A. e seus perigos ocupam seu livro mais recente, Superintelligence

(Superinteligência, ainda sem previsão de lançamento no Brasil). Bostrom alerta para o advento

de sistemas não só inteligentes, mas capazes de se autoaprimorar. Um computador assim

poderia se reprogramar para elevar sua própria capacidade. Mais poderoso, poderia fazer isso de

novo, e de novo. Desenvolveria, assim, capacidades de observação, aprendizado e planejamento

muito superiores à humana. Bostrom chama esse fenômeno de superinteligência e conclui que

ele é o principal risco existencial visível no futuro da humanidade. “Não devemos acreditar que

o cérebro humano poderá competir com isso”, diz.

O filósofo acredita que o surgimento de tecnologia assim não é questão de “se”, e sim de

“quando”. Em 2012 e 2013, ele fez um levantamento de opinião a respeito com 170 especialistas.

Na média, eles estimaram em 50% a chance de surgir, até 2050, uma I.A. capaz de assumir a

maior parte das profissões humanas e em 90% a chance de isso ocorrer até 2075. Mais da

metade dos entrevistados previu que a superinteligência emergiria até 30 anos depois e que

haverá 33% de chance de ela ser algo “ruim” ou “extremamente ruim”.

As preocupações se amparam na aceleração da evolução na área. Bart Selman,

matemático da Universidade Cornell, estuda I.A. desde os anos 1980 e se impressiona com os

avanços dos últimos cinco anos. Carros autônomos, software de tradução simultânea e de

reconhecimento de imagem usam avanços obtidos com I.A. Conforme surgem aplicações

comerciais, mais dinheiro flui para esse tipo de pesquisa, o que a acelera. Novas fronteiras de

estudo, como as redes neurais artificiais e os chips neuromórficos, abrem frentes promissoras na

tentativa de reproduzir o jeito humano de pensar.

Nada garante, porém, que uma superinteligência – uma inteligência capaz de aprimorar a si

mesma – continuará a pensar imitando o jeito humano, ou de forma que seja previsível ou

compreensível por nós. Diante dessa possibilidade, homens inteligentes reagiram com

superlativos. Musk comparou o ato de criar I.A. com invocar o demônio. Hawking afirmou que o

advento da I.A. será o maior evento da história humana. “Infelizmente, poderia também ser o

último, a não ser que aprendamos a evitar os riscos”, disse. O astrofísico tocou no ponto certo.

Nenhum dos estudiosos imagina interromper o avanço científico. Eles apenas ponderam que,

antes de criar I.A., precisaremos criar regras para que seja seguro usá-la – ou conviver com ela.

Disponível em: <http://epoca.globo.com/ideias/noticia/2015/04/o-perigo-da-inteligencia-artificial-parahumanidade.html>. Acesso em: 2 de ago. 2015. [Adaptado]

Provas

Questão presente nas seguintes provas

O texto abaixo servirá de base para a questão.

O perigo da inteligência artificial para a humanidade

Rafael Ciscati e Marcos Coronato

Na ficção científica, a inteligência artificial, ou I.A., tem alguns papéis recorrentes. Costuma

brilhar como a antagonista que pretende exterminar a humanidade. Esse é o propósito da Skynet,

a versão militar e maligna da internet, no filme O exterminador do futuro: gênesis, a estrear em

2015. Nos últimos meses, os perigos da I.A. vêm sendo discutidos mais seria mente por gente

brilhante como o astrofísico Stephen Hawking e o empresário Elon Musk, atuante nos setores

de carros elétricos e exploração espacial. Porém, poucos atentaram à ideia central do pensador

que desencadeou a discussão. O filósofo sueco Nick Bostrom não teme que as I.A’s. detestem

pessoas ou que tentem machucá-las e afirma que “essas máquinas serão indiferentes a nós”.

Formas de I.A. indiferentes à humanidade ou com estratégias incompreensíveis por nós

poderiam causar destruição física e caos social ao controlar bancos de dados, mercados

financeiros, infraestrutura, redes de distribuição e sistemas de armamentos. Bostrom,

pesquisador na Universidade de Oxford, no Reino Unido, dirige o Instituto para o Futuro da

Humanidade. Pesquisa riscos existenciais à vida humana, como a colisão de asteroides com a

Terra. O surgimento da I.A. e seus perigos ocupam seu livro mais recente, Superintelligence

(Superinteligência, ainda sem previsão de lançamento no Brasil). Bostrom alerta para o advento

de sistemas não só inteligentes, mas capazes de se autoaprimorar. Um computador assim

poderia se reprogramar para elevar sua própria capacidade. Mais poderoso, poderia fazer isso de

novo, e de novo. Desenvolveria, assim, capacidades de observação, aprendizado e planejamento

muito superiores à humana. Bostrom chama esse fenômeno de superinteligência e conclui que

ele é o principal risco existencial visível no futuro da humanidade. “Não devemos acreditar que

o cérebro humano poderá competir com isso”, diz.

O filósofo acredita que o surgimento de tecnologia assim não é questão de “se”, e sim de

“quando”. Em 2012 e 2013, ele fez um levantamento de opinião a respeito com 170 especialistas.

Na média, eles estimaram em 50% a chance de surgir, até 2050, uma I.A. capaz de assumir a

maior parte das profissões humanas e em 90% a chance de isso ocorrer até 2075. Mais da

metade dos entrevistados previu que a superinteligência emergiria até 30 anos depois e que

haverá 33% de chance de ela ser algo “ruim” ou “extremamente ruim”.

As preocupações se amparam na aceleração da evolução na área. Bart Selman,

matemático da Universidade Cornell, estuda I.A. desde os anos 1980 e se impressiona com os

avanços dos últimos cinco anos. Carros autônomos, software de tradução simultânea e de

reconhecimento de imagem usam avanços obtidos com I.A. Conforme surgem aplicações

comerciais, mais dinheiro flui para esse tipo de pesquisa, o que a acelera. Novas fronteiras de

estudo, como as redes neurais artificiais e os chips neuromórficos, abrem frentes promissoras na

tentativa de reproduzir o jeito humano de pensar.

Nada garante, porém, que uma superinteligência – uma inteligência capaz de aprimorar a si

mesma – continuará a pensar imitando o jeito humano, ou de forma que seja previsível ou

compreensível por nós. Diante dessa possibilidade, homens inteligentes reagiram com

superlativos. Musk comparou o ato de criar I.A. com invocar o demônio. Hawking afirmou que o

advento da I.A. será o maior evento da história humana. “Infelizmente, poderia também ser o

último, a não ser que aprendamos a evitar os riscos”, disse. O astrofísico tocou no ponto certo.

Nenhum dos estudiosos imagina interromper o avanço científico. Eles apenas ponderam que,

antes de criar I.A., precisaremos criar regras para que seja seguro usá-la – ou conviver com ela.

Disponível em: <http://epoca.globo.com/ideias/noticia/2015/04/o-perigo-da-inteligencia-artificial-parahumanidade.html>. Acesso em: 2 de ago. 2015. [Adaptado]

Provas

Questão presente nas seguintes provas

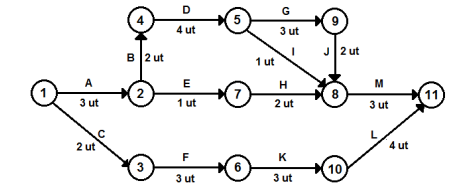

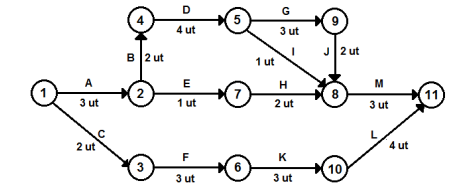

A Figura a seguir apresenta um diagrama PERT/CPM referente à execução de uma obra.

Nesse diagrama, as atividades a serem executadas são designadas por letras maiúsculas e seus tempos de execução em ut (unidades de tempo). Considerando essa figura, o caminho crítico tem um tempo de

Nesse diagrama, as atividades a serem executadas são designadas por letras maiúsculas e seus tempos de execução em ut (unidades de tempo). Considerando essa figura, o caminho crítico tem um tempo de

Provas

Questão presente nas seguintes provas

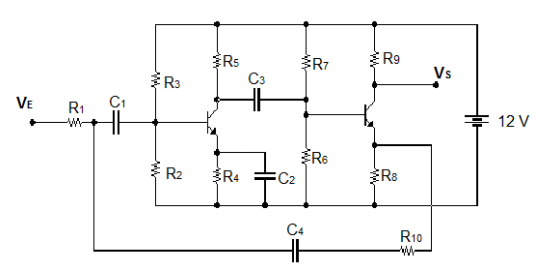

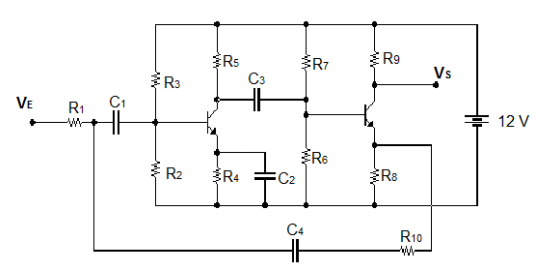

O circuito mostrado a seguir foi polarizado de forma que não haja distorções por corte,

saturação e não linearidades dos transistores, quando for acoplado a um sinal senoidal de

entrada " VE" . As reatâncias dos capacitores nas frequências de operação são desprezíveis. O

sinal de saída " Vs " é mostrado no circuito.

Nesse caso, a realimentação do circuito é do tipo

Nesse caso, a realimentação do circuito é do tipo

Provas

Questão presente nas seguintes provas

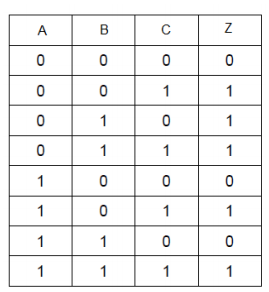

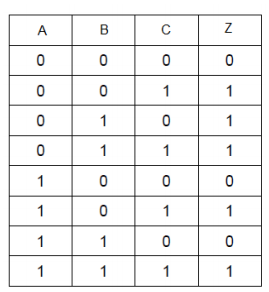

As entradas A, B, C e a saída Z de um circuito digital são representadas pela tabela verdade

a seguir.

A expressão booleana simplificada obtida a partir da tabela verdade é

A expressão booleana simplificada obtida a partir da tabela verdade é

Provas

Questão presente nas seguintes provas

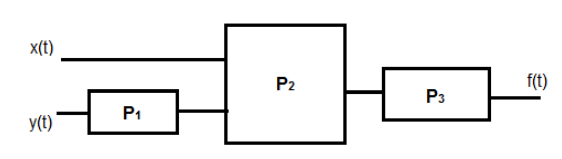

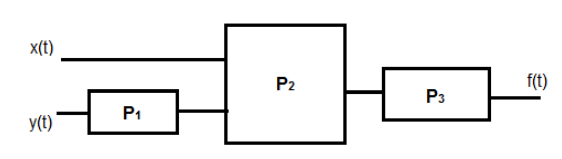

O circuito representado pelo diagrama de blocos abaixo é usado em um PLL. “P1” é um

circuito defasador de (+ 90°), “P2” é um circuito multiplicador de quatro quadrantes e “P3”

é um filtro passa-baixa que tem um pólo em ωp = 10 rad/s. Os sinais aplicados a entrada

são x(t) = sen(104t + ⌀) e y(t) = sen(104t).

No caso, a saída f(t) é, aproximadamente, a função

No caso, a saída f(t) é, aproximadamente, a função

Provas

Questão presente nas seguintes provas

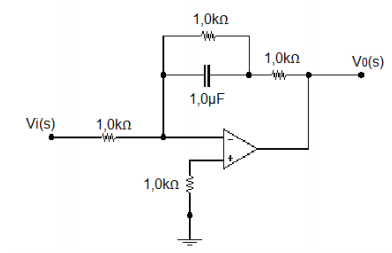

No diagrama de Bode, são marcados os pólos e os zeros da função de transferência F(s) = V0(s) / Vi(s). No circuito a seguir, o operacional é ideal e opera na região linear.

Em relação ao circuito, serão marcados no diagrama de Bode,

Provas

Questão presente nas seguintes provas

Os equalizadores adaptativos, muito usados nos receptores de rádios digitais, têm como

principal função

Provas

Questão presente nas seguintes provas

O sistema GSM (global system for mobile communications) é o padrão mais utilizado hoje no

mundo e foi desenvolvido na Europa, no final da década de 1980, para solucionar a falta de

padronização de sistemas celulares, analógicos, limitando os serviços prestados. No Brasil, o

sistema foi implantado em 2002, substituindo as redes celulares digitais que usavam o padrão

IS-136 (TDMA). A tecnologia GSM possui padrões definidos de acordo com sua faixa de

operação. O padrão GSM que oferece a maior gama de serviços aos usuários é o

Provas

Questão presente nas seguintes provas

A garantia de que uma chamada originada em qualquer ponto dentro da área de serviço se

mantenha sem interrupções, enquanto o assinante estiver em movimento, é possível devido

ao mecanismo de handoff, que é o processo de troca de frequências das portadoras alocadas

ao telefone, quando o assinante sai da região de cobertura de uma ERB para outra. Na

telefonia celular, essa funcionalidade é chamada de

Provas

Questão presente nas seguintes provas

Cadernos

Caderno Container